كيفية إنشاء وتقديم ملف robots.txt مثالي لموقع ووردبريس

لضمان أن يحتل موقعك مرتبة عالية في صفحات نتائج محرك البحث (SERPs) ، ستحتاج إلى تسهيل عملية البحث في محركات البحث (bots) لاستكشاف أهم صفحاته. سيساعدك وجود ملف robots.txt جيد التنظيم في توجيه هذه الروبوتات إلى الصفحات التي تريد فهرستها (وتجنب الباقي).

في هذه المقالة ، سنغطي:

- ما هو ملف robots.txt وما أهميته

- أين يوجد ملف robots.txt لموقع ووردبريس.

- كيفية إنشاء ملف robots.txt.

- ما هي القواعد التي يجب تضمينها في ملف robots.txt الخاص بـ WordPress.

- كيفية اختبار ملف robots.txt وإرساله إلى Google Search Console.

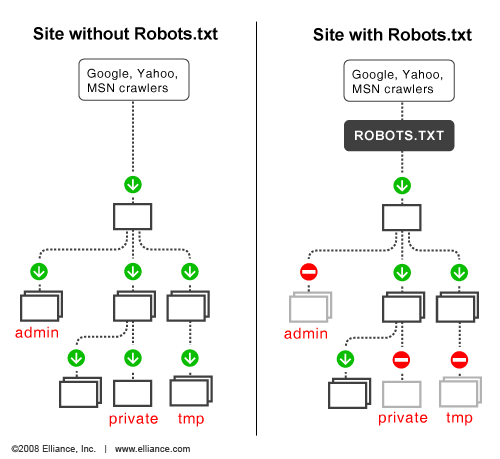

في الصورة أدناه نوضح كيف يعمل! عندما يكون روبوت محرك البحث على وشك الزحف إلى عنوان URL لموقع الويب الخاص بك (أي ، سوف يزحف ويسترجع المعلومات حتى يمكن فهرستها) ، سيبحث أولاً عن ملف robots.txt الخاص بك.

بحلول نهاية مناقشتنا ، سيكون لديك كل ما تحتاجه لتكوين ملف robots.txt مثالي لموقع الويب الخاص بك على WordPress. هيا بنا نغطس!

جدول المحتويات

- ما هو ملف robots.txt الخاص بـ WordPress (ولماذا تحتاج واحد)

- أين يوجد ملف robots.txt لموقع ووردبريس؟

- ماذا يجب أن تكتب في ملف robots.txt الخاص بـ WordPress

- كيفية إنشاء ملف robots.txt للووردبريس (3 طرق)

- 1. استخدام إضافة Yoast SEO

- 2. من خلال اضافة All in One SEO Pack

- 3. إنشاء ورفع ملف robots.txt الخاص بـموقع ووردبريس عبر FTP

- كيفية اختبار ملف robots.txt الخاص بـ WordPress وإرساله إلى Google Search Console

- استنتاج

ما هو ملف robots.txt الخاص بـ WordPress (ولماذا تحتاج واحد)

ما يقدمه ملف robots.txt هو توفير مجموعة من الإرشادات لبوتات محركات البحث. يقول لهم: “مهلاً ، يمكنك أن تبحث هنا ، لكن لا تذهب إلى تلك الغرف هناك!” يمكن أن يكون هذا الملف مفصلاً كما تريد ، ومن السهل إنشاؤه ، حتى لو لم تكن معالجاً تقنياً.

في الممارسة العملية ، ستواصل محركات البحث الزحف إلى موقع الويب الخاص بك وفهرسته حتى إذا لم يكن لديك ملف robots.txt مُعد. ومع ذلك ، بدون هذا الملف ، تترك الأمر متروكًا للروبوتات لفهرسة كل المحتوى الخاص بك ، وهو شامل لدرجة أنه قد ينتهي به الأمر إلى عرض أجزاء من موقع الويب الخاص بك لا تريد أن يتمكن الآخرون من الوصول إليها.

الأهم من ذلك ، أنه بدون ملف robots.txt ، سيكون لديك الكثير من روبوتات الزحف إلى جميع أنحاء موقع الويب الخاص بك. هذا يمكن أن يؤثر سلباً على أداء موقعك. حتى إذا كانت الضربة ضئيلة ، فإن سرعة تحميل الصفحة هي شيء يجب أن يكون دائمًا في قمة قائمة أولوياتك.

بعد كل شيء ، هناك القليل من الأشياء التي يكرهها الأشخاص مثل المواقع الإلكترونية البطيئة (وهذا يشملنا!).

أين يوجد ملف robots.txt لموقع ووردبريس؟

عند إنشاء موقع وورد بريس على الويب ، فإنه يقوم تلقائيًا بإعداد ملف robots.txt افتراضي موجود في المجلد الرئيسي لخادمك. على سبيل المثال ، إذا كان موقعك موجودًا على yournewwebsite.com ، فيمكنك زيارة العنوان yournewwebsite.com/robots.txt ، ومشاهدة ملف مثل هذا:

User-agent: *

Disallow: /wp-admin/

Disallow: /wp-includes/هذا مثال على ملف robots.txt أساسي للغاية. لتوضيح الصورة بالنسبة لك ، الجزء الموجود مباشرة بعد User-agent: يُصرح أي برامج الروبوت التي تنطبق عليها القواعد أدناه.

النجمة تعني أن القواعد عالمية وتنطبق على جميع برامج الروبوت. في هذه الحالة ، يخبر الملف تلك الروبوتات أنه لا يمكنهم الدخول إلى مجلدات wp-admin و wp-include. هذا يجعل قدر معين من المعنى لأن هذين المجلدين يحتويان على الكثير من الملفات الحساسة.

ومع ذلك ، قد ترغب في إضافة المزيد من القواعد إلى الملف الخاص بك. قبل أن تتمكن من القيام بذلك ، ستحتاج إلى فهم أن هذا ملف افتراضي.

عادةً ما يكون مكان ملف robots.txt لمواقع ووردبريس ضمن دليل الجذر الخاص بك ، والذي يُطلق عليه غالبًا public_html أو www (أو على اسم موقع الويب الخاص بك):

ومع ذلك ، فإن ملف robots.txt الذي يعده WordPress لك افتراضيًا لا يمكن الوصول إليه على الإطلاق ، من أي دليل. إنه يعمل ، ولكن إذا كنت تريد إجراء تغييرات عليه ، فستحتاج إلى إنشاء ملف خاص بك وتحميله إلى مجلد الجذر كبديل.

سنغطي عدة طرق لإنشاء ملف robots.txt جديد لـلووردبريس خلال دقيقة واحدة. الآن ، على الرغم من ذلك ، دعونا نتحدث عن كيفية تحديد القواعد التي يجب أن يتضمنها ملفك.

ماذا يجب أن تكتب في ملف robots.txt الخاص بـ WordPress

في القسم الأخير ، شاهدت مثالًا لملف robots.txt الذي أنشأه WordPress. لم يتضمن سوى قاعدتين قصيرتين ، لكن معظم مواقع الويب أقامت أكثر من ذلك. دعونا نلقي نظرة على ملفين مختلفين من ملفات robots.txt ، ونتحدث عما يفعله كل منهما بشكل مختلف.

هذا هو المثال الأول لملف WordPress robots.txt:

User-agent: *

Allow: /

# Disallowed Sub-Directories

Disallow: /checkout/

Disallow: /images/

Disallow: /forum/هذا ملف robots.txt عام لموقع ويب به منتدى. غالبًا ما تقوم محركات البحث بفهرسة كل موضوع داخل المنتدى. بناءً على ماهية المنتدى ، قد ترغب في عدم السماح بذلك. بهذه الطريقة ، لن تفهرس Google مئات سلاسل الرسائل حول المستخدمين الذين يقومون بإجراء محادثة صغيرة. يمكنك أيضًا إعداد قواعد تشير إلى منتديات فرعية معينة لتجنبها ، والسماح لمحركات البحث بالزحف إلى باقيها.

ستلاحظ أيضًا سطرًا أسمه Allow: / في الجزء العلوي من الملف. يخبر هذا السطر برامج التتبع بأنه يمكنها الزحف إلى جميع صفحات موقع الويب الخاص بك ، باستثناء الاستثناءات التي حددتها أدناه. وبالمثل ، ستلاحظ أننا قمنا بتعيين هذه القواعد لتكون عالمية (مع علامة النجمة) ، تماماً كما يفعل ملف robots.txt الافتراضي الخاص بـ WordPress.

الآن دعونا نتحقق من مثال آخر لبرنامج WordPress robots.txt:

User-agent: *

Disallow: /wp-admin/

Disallow: /wp-includes/

User-agent: Bingbot

Disallow: /في هذا الملف ، قمنا بإعداد نفس القواعد التي يستخدمها WordPress افتراضيًا. ومع ذلك ، أضفنا أيضًا مجموعة جديدة من القواعد التي تمنع روبوت البحث في Bing من الزحف عبر موقعنا. Bingbot ، كما قد تتخيل ، هو اسم هذا الروبوت.

يمكنك التعرف بشكل محدد على أي روبوتات محركات البحث يمكنها الوصول إلى موقع الويب الخاص بك ، وأي منها لا تستطيع ذلك. في الممارسة العملية ، بطبيعة الحال ، Bingbot حميدة إلى حد ما (حتى لو لم يكن رائعًا مثل Googlebot). ومع ذلك ، هناك بعض السير الخبيثة هناك.

الأخبار السيئة هي أنهم لا يتبعون دائمًا تعليمات ملف robots.txt الخاص بك (فهم متمردون ، بعد كل شيء). تجدر الإشارة إلى أنه على الرغم من أن معظم برامج التتبع ستتبع الإرشادات التي تقدمها في هذا الملف ، إلا أنك لا تجبرهم على ذلك. أنت فقط تسأل بلطف.

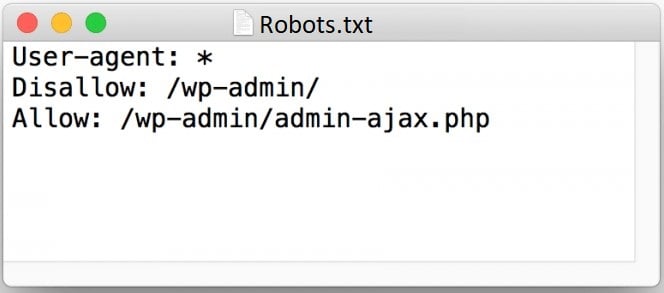

إذا قرأت عن الموضوع ، فستجد الكثير من الاقتراحات بشأن ما يجب السماح به وما الذي يجب حظره على موقع ووردبريس. ومع ذلك ، في تجربتنا ، وغالبا ما تكون قواعد أقل أفضل. فيما يلي مثال على ما نوصي أن يكون عليه ملف robots.txt:

User-agent: *

Disallow: /wp-admin/

Allow: /wp-admin/admin-ajax.php

Disallow: /wp-includes/

Allow: /wp-includes/js/

Allow: /wp-includes/images/

User-agent: Mediapartners-Google*

Allow: /

User-agent: Googlebot-Image

Allow: /wp-content/uploads/

Sitemap: https://YourSiteURL.com/sitemap.xmlومع ذلك ، فإن ما تدرجه في ملف robots.txt يعتمد على موقعك واحتياجاتك الخاصة. لذلك لا تتردد في القيام ببعض البحوث بنفسك!

كيفية إنشاء ملف robots.txt للووردبريس (3 طرق)

بمجرد أن تقرر ما سيذهب في ملف robots.txt الخاص بك ، كل ما تبقى هو إنشاء ملف. يمكنك تحرير ملف robots.txt في وورد بريس إما باستخدام مكون إضافي أو يدوياً. في هذا القسم ، سنعلمك كيفية استخدام اثنين من المكونات الإضافية الشائعة لإنجاز المهمة ومناقشة كيفية إنشاء الملف وتحميله بنفسك. دعنا نذهب اليها!

1. استخدام إضافة Yoast SEO

Yoast SEO بالكاد يحتاج إلى مقدمة. إنه البرنامج المساعد الأكثر شيوعًا للسيو في WordPress ، وهو يمكّنك من تحسين مقالاتك وصفحاتك للاستفادة بشكل أفضل من كلماتك الرئيسية. بصرف النظر عن ذلك ، فإنه يوفر لك أيضًا المساعدة عندما يتعلق الأمر بزيادة قابلية قراءة المحتوى الخاص بك ، مما يعني أن المزيد من الناس سيكونون قادرين على الاستمتاع به.

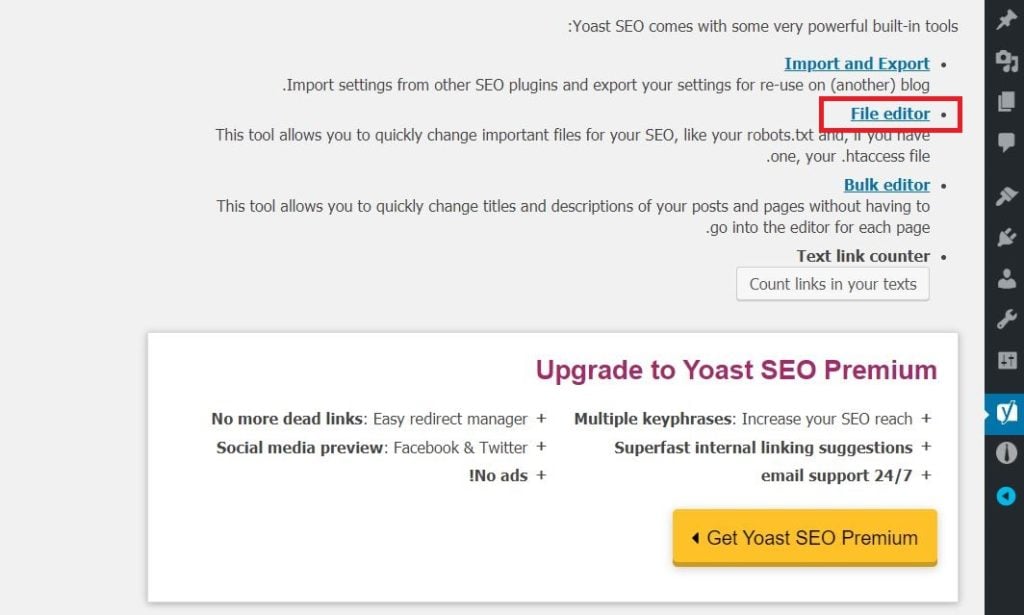

شخصياً ، نحن من عشاق Yoast SEO نظرًا لسهولة استخدامها. ينطبق هذا بنفس القدر على إنشاء ملف robots.txt. بمجرد تثبيت الاضافة وتنشيطها ، انتقل إلى علامة التبويب SEO › Tools في لوحة المعلومات ، وابحث عن الخيار الذي يقول File editor:

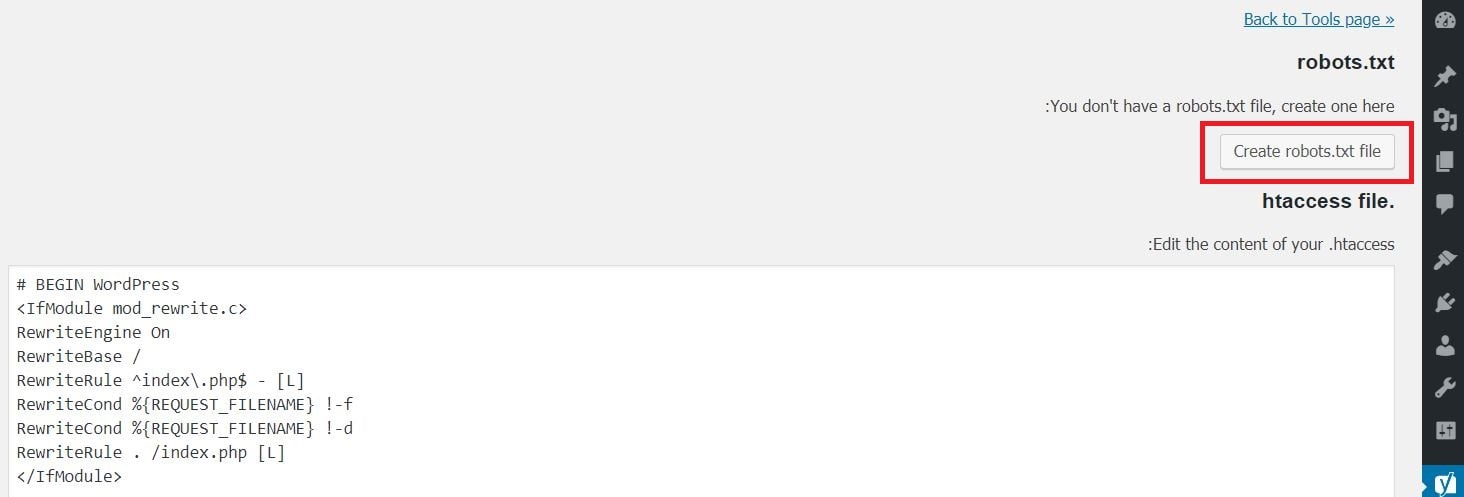

سيؤدي النقر فوق هذا الرابط إلى إرسالك إلى صفحة جديدة ، حيث يمكنك تعديل ملف htaccess الخاص بك دون مغادرة لوحة التحكم. هناك أيضًا زر مفيد اسمه Create robots.txt file ، وهو يفعل بالضبط ما تتوقعه:

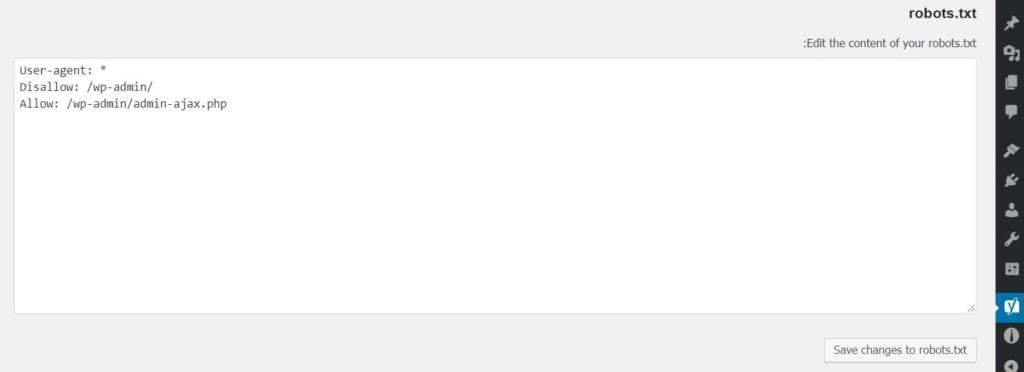

بمجرد النقر فوق هذا الزر ، ستعرض علامة التبويب محررًا جديدًا حيث يمكنك تعديل ملف robots.txt الخاص بك مباشرةً.

عندما تضيف القواعد أو تزيلها ، تذكر أن تنقر فوق الزر “Save changes to robots.txt” ، لحفظ الملف:

هذا سهل بما فيه الكفاية! الآن دعونا نرى كيف تفعل الاضافة الأخرى الشهيرة نفس الشيء.

2. من خلال اضافة All in One SEO Pack

All in One SEO Pack هو الاسم الكبير الآخر عندما يتعلق الأمر بـ WordPress SEO. تتضمن معظم الميزات الموجودة في Yoast SEO ، لكن بعض الناس يفضلونها لأنها إضافة خفيفة الوزن. بقدر ما يذهب ملف robots.txt ، فإن إنشاء الملف باستخدام هذا المكون الإضافي هو بنفس البساطة.

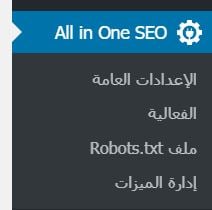

بمجرد الانتهاء من إعداد المكون الإضافي ، انتقل إلى صفحة All in One SEO > ادارة الميزات في لوحة المعلومات.

في الداخل ، ستجد خياراً يسمى ملف Robots.txt ، مع زر تنشيط واضح أسفله مباشرة. قم بالمضي قدماً وانقر على ذلك:

سيتم تفعيل ميزة التحكم في ملف robots.txt لموقعك من داخل الإضافة.

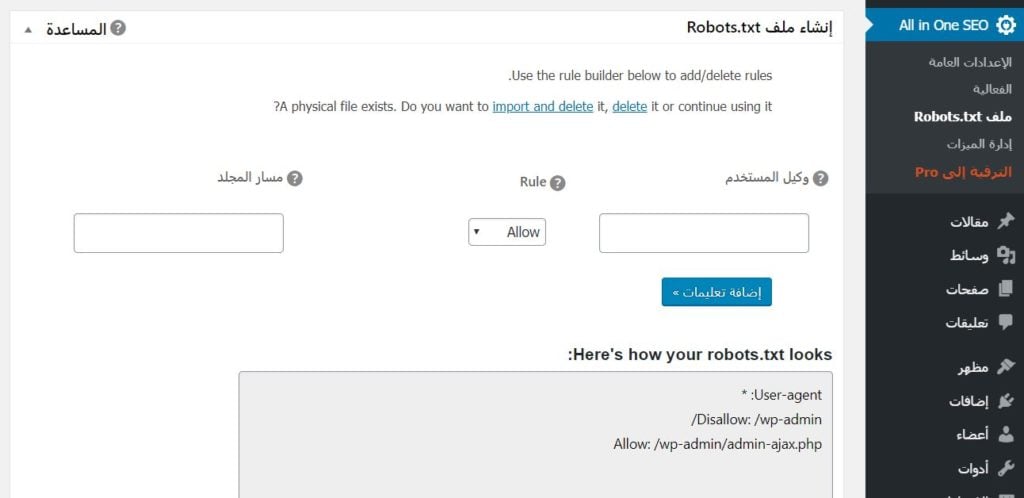

الآن ، ستظهر علامة تبويب Robots.txt جديدة أسفل قائمة تحسين محركات البحث الخاصة بك. إذا نقرت عليه ، فسترى خيارات لإضافة قواعد جديدة إلى ملفك ، أو حفظ التغييرات التي تجريها ، أو حذفها تماماً.

لاحظ أنه لا يمكنك إجراء تغييرات على ملف robots.txt الخاص بك مباشرةً باستخدام هذه الإضافة. الملف نفسه باللون الرمادي ، على عكس Yoast SEO ، والتي تمكنك من كتابة ما تريد:

في أي حال ، تعتبر إضافة قواعد جديدة أمرًا بسيطًا ، لذا لا تدع هذا الجانب السلبي يثبطك.

هذا كل ما عليك فعله إذا اخترت استخدام هذه الطريقة. ومع ذلك ، دعونا نتحدث عن كيفية إنشاء ملف robots.txt يدويًا ، إذا كنت لا ترغب في إعداد مكون إضافي لمجرد الاهتمام بهذه المهمة.

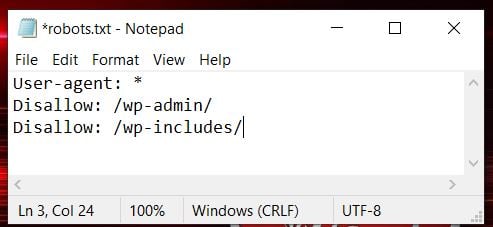

3. إنشاء ورفع ملف robots.txt الخاص بـموقع ووردبريس عبر FTP

لا يمكن أن يكون إنشاء ملف txt أبسط. كل ما عليك فعله هو فتح محرر النصوص المفضل لديك (مثل Notepad أو TextEdit) ، واكتب بضعة أسطر. ثم يمكنك حفظ الملف ، بإسم “robots” ونوع الملف txt. يستغرق الأمر حرفياً بضع ثوانٍ للقيام بذلك ، لذلك فمن المنطقي أنك قد ترغب في تحرير ملف robots.txt في WordPress دون استخدام مكون إضافي.

إليك مثال سريع على أحد هذه الملفات:

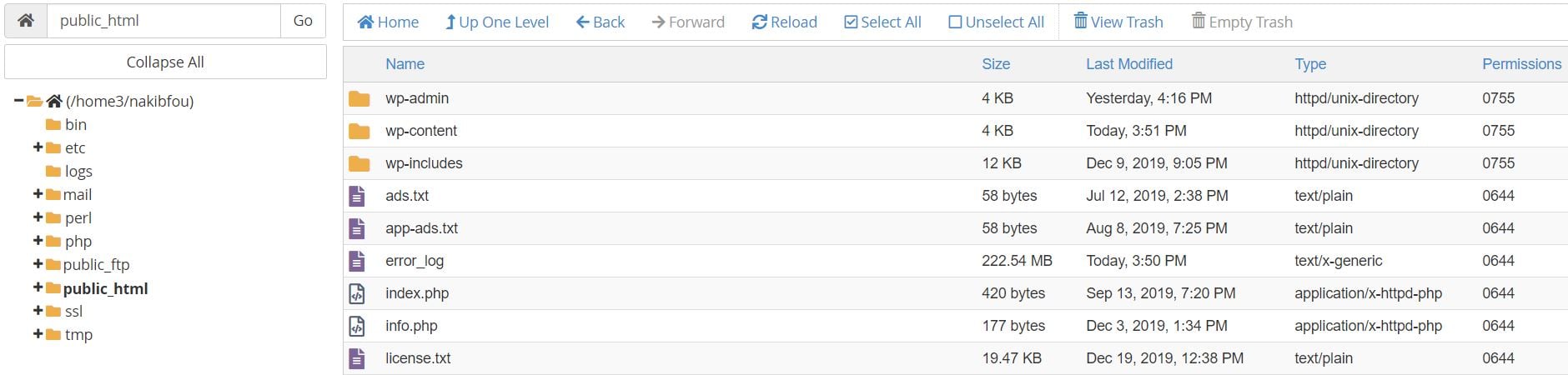

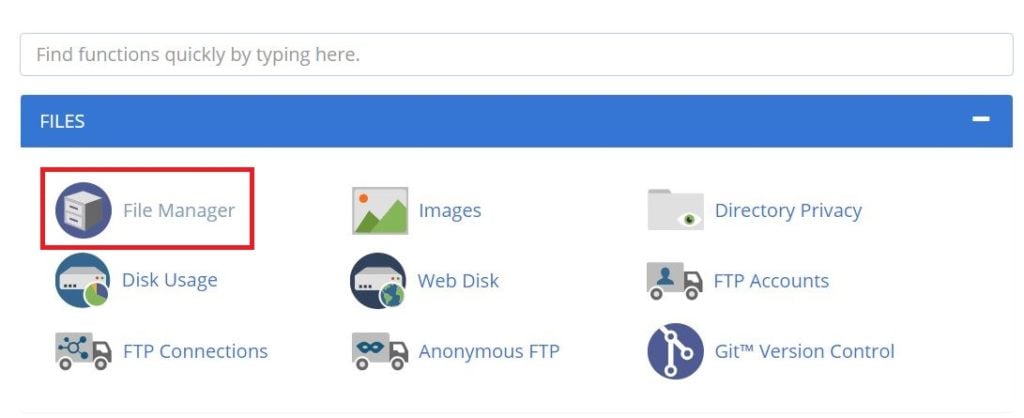

بمجرد إنشاء الملف الخاص بك وحفظه ، ستحتاج إلى الاتصال بموقعك عبر تسجيل الدخول إلى لوحة Cpanel. بعد تسجيل الدخول إلى لوحة التحكم (Cpanel) إختر File Manager:

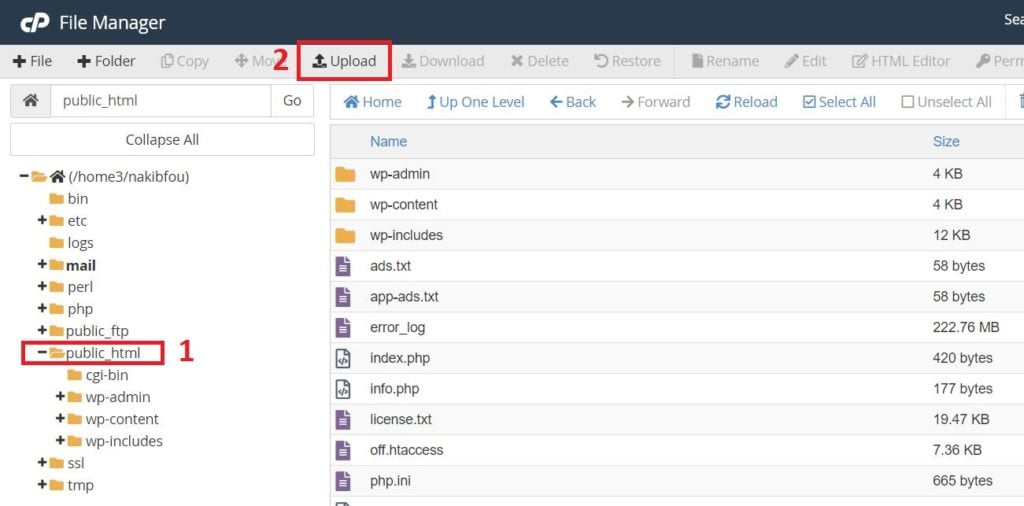

بمجرد الدخول الى File Manager ، انتقل إلى المجلد public_html. بعد ذلك ، كل ما عليك فعله هو رفع ملف robots.txt من جهاز الكمبيوتر الخاص بك إلى خادمك. يمكنك رفع الملف عن طريق النقر على خيار Upload.

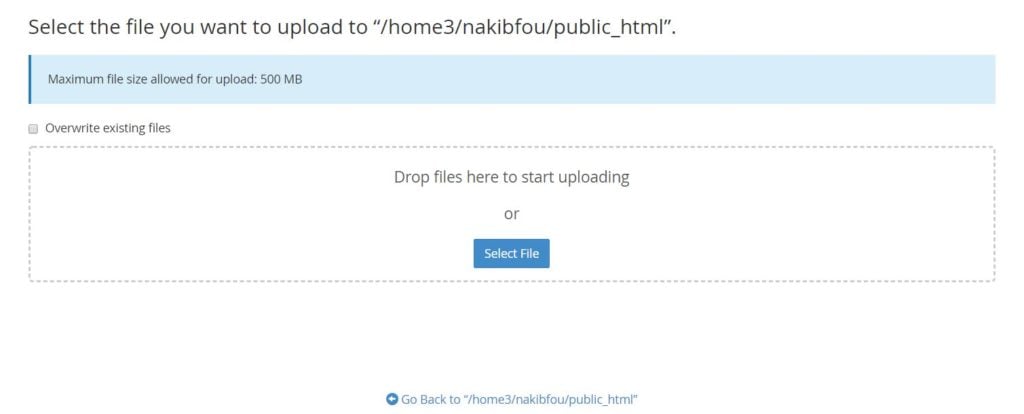

بعد ذلك يمكنك أما سحب الملف من جهاز الكمبيوتر الخاص بك وإفلاته أو رفع الملف عن طريق النقر على Select File وإختيار الملف من الكمبيوتر.

كما ترون ، هذه الطريقة بسيطة مثل استخدام مكون إضافي.

كيفية اختبار ملف robots.txt الخاص بـ WordPress وإرساله إلى Google Search Console

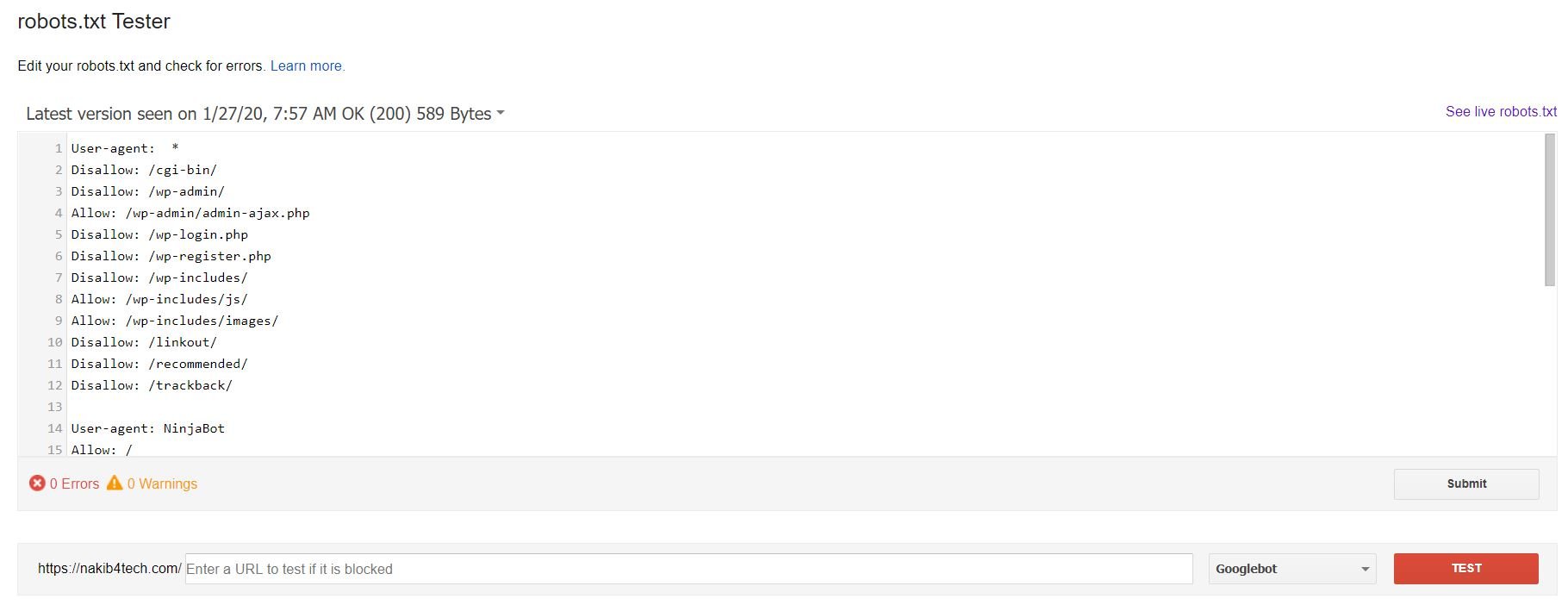

بمجرد إنشاء ملف WordPress robots.txt وتحميله ، يمكنك استخدام Google Search Console لاختباره بحثاً عن الأخطاء. Search Console هي مجموعة من الأدوات التي تقدمها Google لمساعدتك في مراقبة كيفية ظهور المحتوى الخاص بك في نتائج البحث. إحدى هذه الأدوات هي مدقق ملف robots.txt ، والذي يمكنك استخدامه من خلال فتح الرابط التالي:

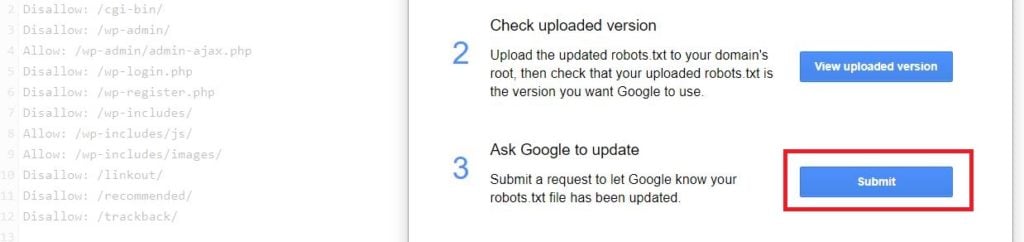

في الداخل ، ستجد حقل محرر يمكنك من خلاله إضافة كود ملف robots.txt الخاص بك ، والنقر على زر إرسال أدناه. سوف تسأل Google Search Console عما إذا كنت تريد استخدام هذا الرمز الجديد ، أو سحب الملف من موقع الويب الخاص بك. انقر فوق الخيار الذي يقول “مطالبة Google بالتحديث” لإرساله يدويًا:

الآن ، ستقوم المنصة بفحص ملفك بحثًا عن الأخطاء. إذا كان هناك أي خطأ ، فسيشير لك.

استنتاج

لزيادة عرض موقعك ، ستحتاج إلى التأكد من أن برامج روبوت محرك البحث تقوم بالزحف إلى المعلومات الأكثر صلة. كما رأينا ، سيمكنك ملف WordPress robots.txt الذي تم تكوينه جيدًا من تحديد كيفية تفاعل هذه الروبوتات مع موقعك. وبهذه الطريقة ، سيكون بإمكانهم تقديم محتوى أكثر فائدة ومفيدة للباحثين.

هل لديك أي أسئلة حول كيفية تحرير ملف robots.txt في WordPress؟ اسمحوا لنا أن نعرف في قسم التعليقات أدناه!

فيما يلي بعض المقالات التي أخترتها لك يدوياً لتقرأها بعد ذلك:

- كيفية إنشاء و تقديم ملف Sitemap الخاص بمدونتك أو موقعك إلى مشرفي مواقع جوجل

- التحقق من مدونتك أو موقعك على مشرفي مواقع Bing ، Google و Yahoo

- كيفية اعداد اضافة Yoast SEO بالصور التوضيحية (تحسين سيو ووردبريس)

حول أنمار النقيب

مدون & مطور، أُشارك كل ما تعلمته حول تحسين مواقع ووردبريس للسرعة، ودروس تحسين محركات البحث (SEO). إقرأ سيرتي الذاتية لتتعلم المزيد عني.

السلام عليكم اخى الحبيب

عندى مشكلة لما بدخل على اختبار robots txt يجيلي .. ملف الروبوتس غير موجود 404 رغم انه موجود بالفعل.. ايضا ال sitemap ليها اكثر من اسبوع على وضع تعذر الجلب!!

أهلاً أحمد،

شكراً لك للتعليق، بخصوص مشكلة Sitemap فهذا طبيعي لأن موقعك غير كبير وعدد الروابط في داخل الملف قليل، لذلك لا يقبله جوجل. هذه ليست مشكلة وفقط أيام وتنجخ معالجة الملف.

حول مشكلة ملف robots فأنا لم أفهمها.. لمثل هذه المشكلة أنصحك بالإنضمام لمجموعتنا على فيسبوك وستجد هناك أجوبة حول سؤالك.

تحياتي

السلام عليكم اخي يعطيك العافية

جالي الكود ده في اداة يوست مع العلم اني ناقل بلوجر الي ووردبريس

User-agent: *

Crawl-Delay: 20

حاليا انا اخدت الملف اللي موصي بيه هل يوجد مشكلة في ذلك

وعليكم السلام،

حسناً فعلت اخي ولا توجد مشكلة، لا اوصي بعمل Delay لمحركات البحث إلاّ للمواقع العملاقة جداً وفي حالات نادرة جداً.

شكراً

بارك الله فيك اخي شرحك رائع

رائع اخي اريد ملفات روبو تاكست جاهزة فقط اخير رابط موقعي لو سمحت

صديقي الملف موجود في المقالة فقط أستبدل الرابط في نهاية الملف “YourSite” برابط موقعك وأستعمله!